本文将手把手带你从零搭建一个支持中文简历优化、流式生成、Markdown 渲染的大模型应用。我们使用Next.js 14 作为前端框架,调用本地部署的 DeepSeek-R1 大模型,通过流式响应实时生成高质量简历内容,适合用于求职平台、教学场景、AIGC 简历应用等。

🚀 最终实现目标

用户在前端输入岗位描述 + 个人经历,点击生成,系统使用本地 LLM(如 DeepSeek-R1:7B)调用 Ollama 接口,通过流式方式一行一行返回优化后的简历内容,并用 Markdown 美化展示。

🧱 技术栈概览

- 前端框架:Next.js 14(App Router 架构)

- 样式系统:Tailwind CSS + Typography 插件

- Markdown 渲染:ReactMarkdown

- 本地模型调用:Ollama + DeepSeek-R1

- 流式响应处理:ReadableStream

- 部署结构:全栈项目(无需额外后端)

🧰 搭建步骤

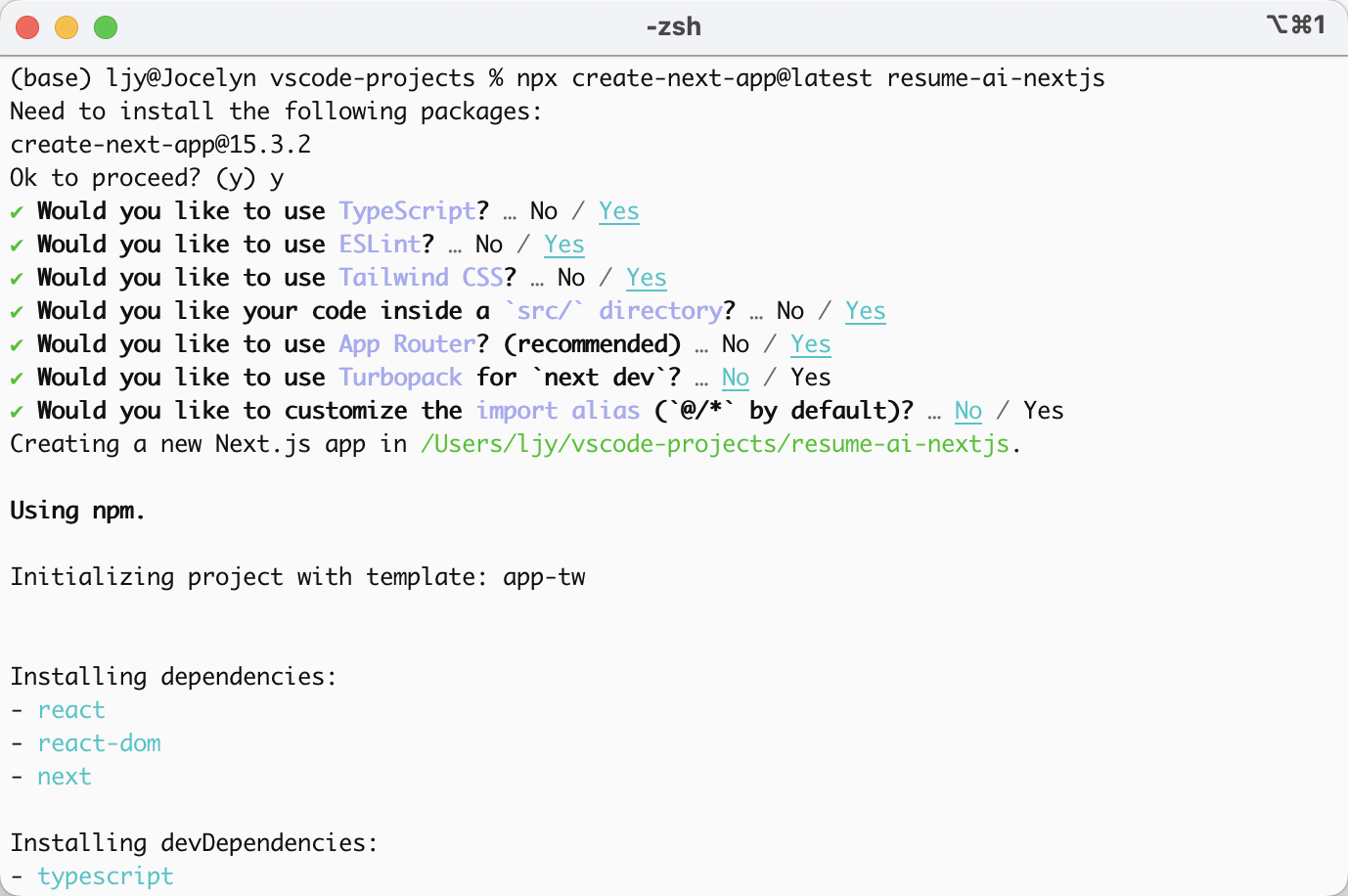

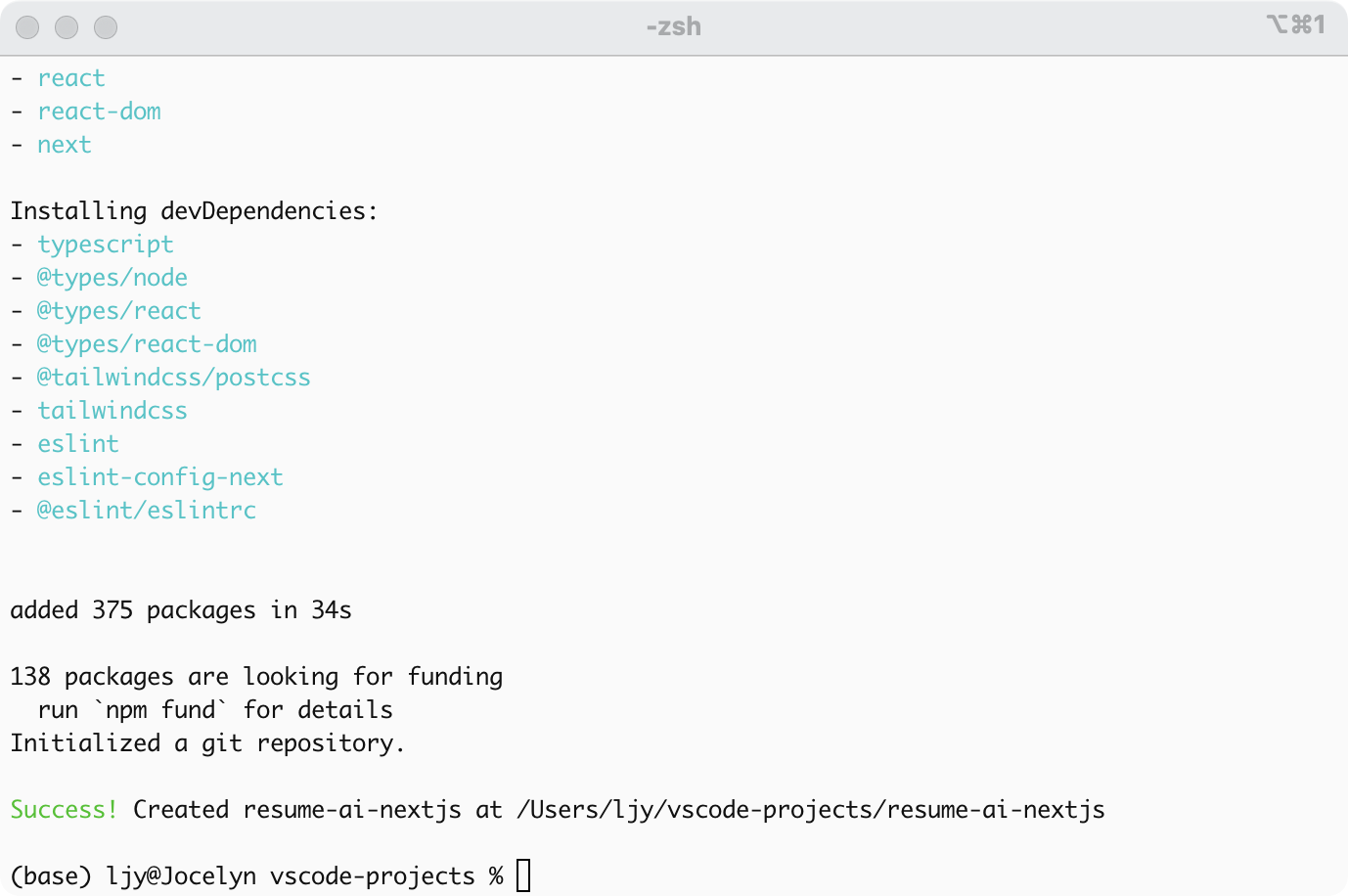

1️⃣ 创建项目

1 | npx create-next-app@latest resume-ai-nextjs |

2️⃣ 手动补齐 Tailwind 配置

1 | npm install -D tailwindcss postcss autoprefixer |

编辑 tailwind.config.ts:

1 | import type { Config } from 'tailwindcss' |

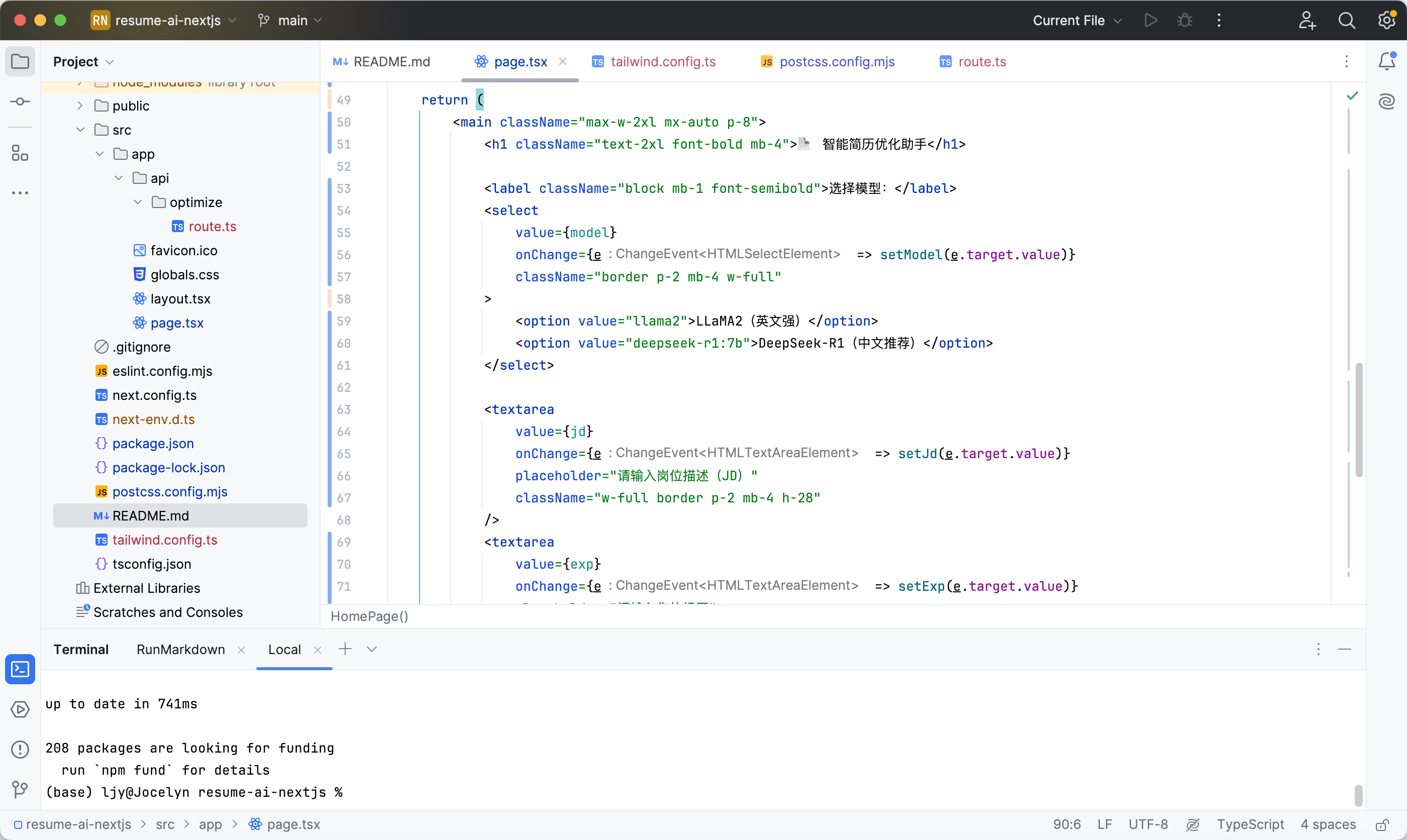

3️⃣ 编写前端简历输入页面

使用 ReactMarkdown 进行渲染,添加模型选择、输入框和按钮:

1 | 'use client' |

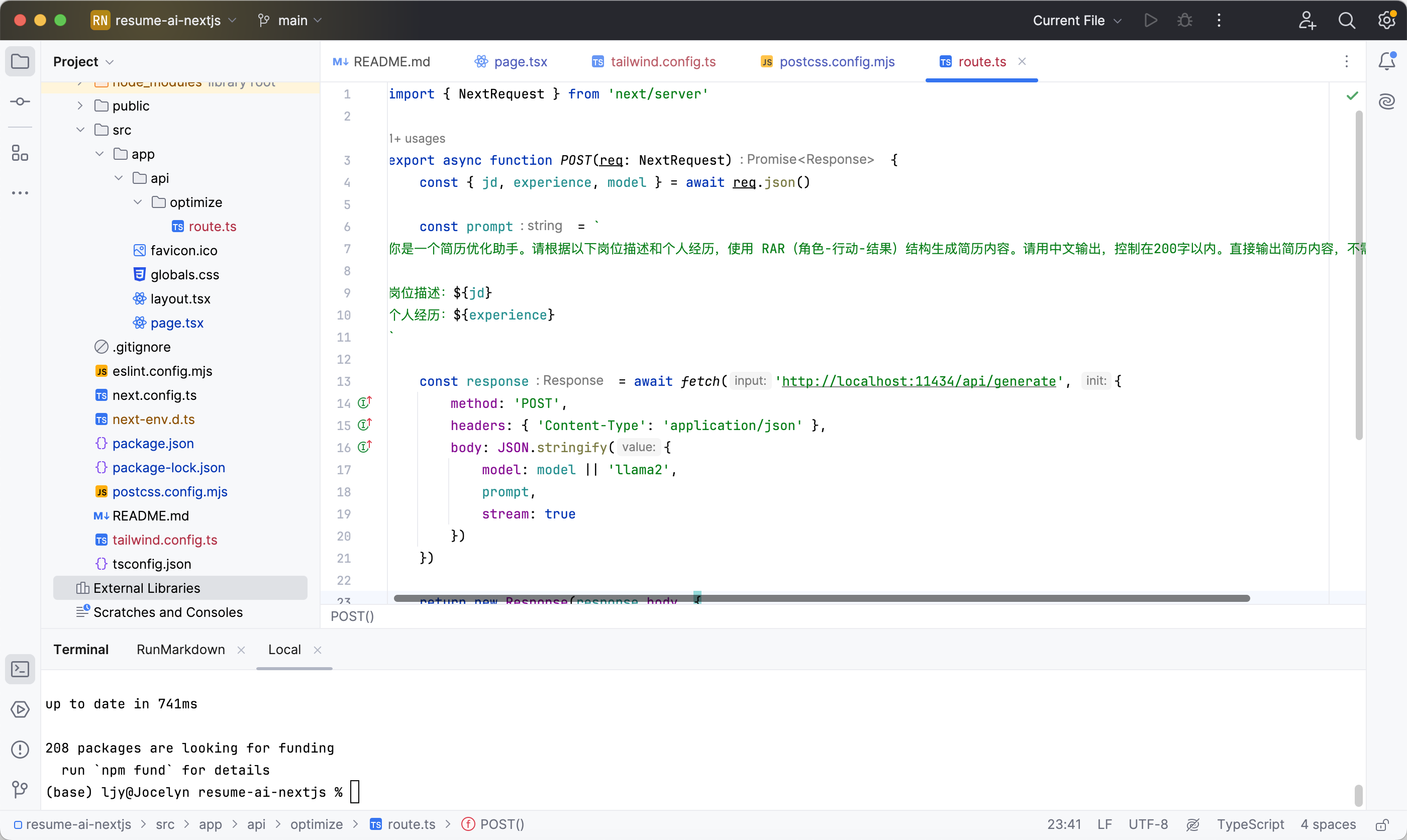

4️⃣ 创建后端接口 /api/optimize

1 | import { NextRequest } from 'next/server' |

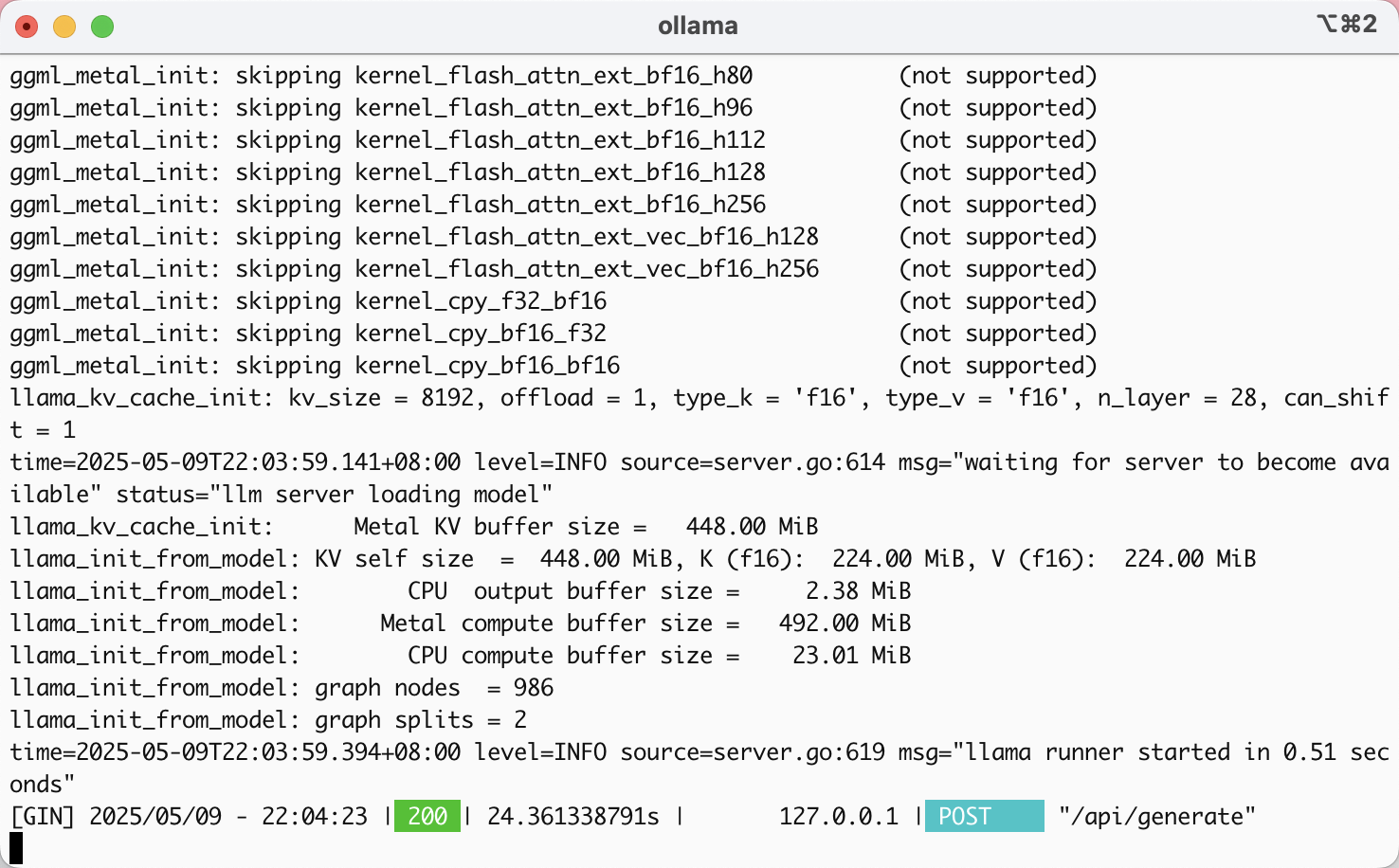

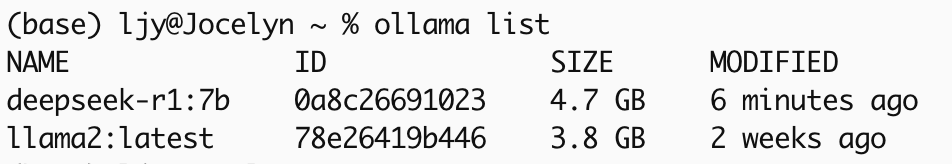

5️⃣ 启动 Ollama 本地模型

1 | ollama pull deepseek-r1:7b |

或者:

1 | ollama serve # 由接口自动加载模型 |

✅ 效果演示(功能一览)

- 🧠 输入岗位 JD + 个人经历

- ✅ 一键生成 RAR 结构简历内容

- 📦 本地运行,无需联网,无隐私泄露

- 💬 Markdown 美观渲染,排版清晰

- 🔄 模型切换:支持 llama2 / deepseek-r1

🧩 可扩展方向

- 💾 保存生成历史

- 🌐 中英文简历切换

- 📋 一键复制 + 导出 PDF

- 🧠 加入 RAG 检索增强模块

如果你也想做一个自己的本地 LLM 简历生成应用,希望这份实践对你有所帮助 🙌

—— 本文完 · 感谢读到这里的你 🐾 ——

作者

金金

版权

采用

知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 许可,转载请注明出处。

知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 许可,转载请注明出处。